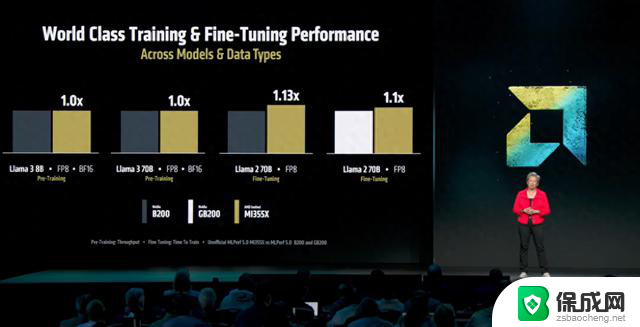

AMD对抗英伟达“杀手锏”:120万片GPU组成AI集群震撼发布

更新时间:2024-06-26 16:22:04作者:zsbaocheng

6 月 26 日消息,全球最强超级计算机所配备的 GPU 数量不到 5 万片,而 AMD 公司为了增强和英伟达的竞争力,目标推出支持 120 万片 GPU 的数据中心 AI 集群。

在接受 The Next Platform 采访时,AMD 数据中心解决方案集团执行副总裁兼总经理 Forrest Norrod 表示,公司正在认真考虑构建最大规模的 AI GPU 集群。

注:AI 训练集群通常由数千片 GPU 构建,通过高速互连连接服务器机架。而 AMD 正研究的 120 万片无疑在数量级上指数倍增长,这必然带来延迟、功耗、硬件故障等多方面的挑战。

全球最强超级计算机 Frontier “只有”37888 片 GPU,因此 AMD 勾勒的 AI 集群是当前最强超级计算机数量的 30 倍。